DeepSeek-R1频繁出现错误输出,引发关注。深入探究后发现其背后原因令人震惊!这款产品在处理某些任务时表现出异常行为模式的原因竟是技术缺陷和算法问题所致。“胡说八道”的背后隐藏着巨大的安全隐患和风险隐患亟待解决的问题引起了公众的高度警觉与担忧意识的重要性不言而喻不容忽视的紧迫性问题亟需重视和解决以维护技术的可靠性和安全性避免潜在风险的发生并保障用户权益的安全性和稳定性至关重要不容小觑摘要字数:约字左右(具体根据实际需求调整)。

一、引言:DeepSeek-R1的“语出惊人”现象

人工智能DeepSeek-R1因其“语出惊人”的表现引发热议,无论是回答常识性问题,还是生成复杂文本,它总能在某些时刻“胡说八道”,让人哭笑不得,为什么一个高科技产物会如此“不靠谱”?今天我们就来一探究竟。

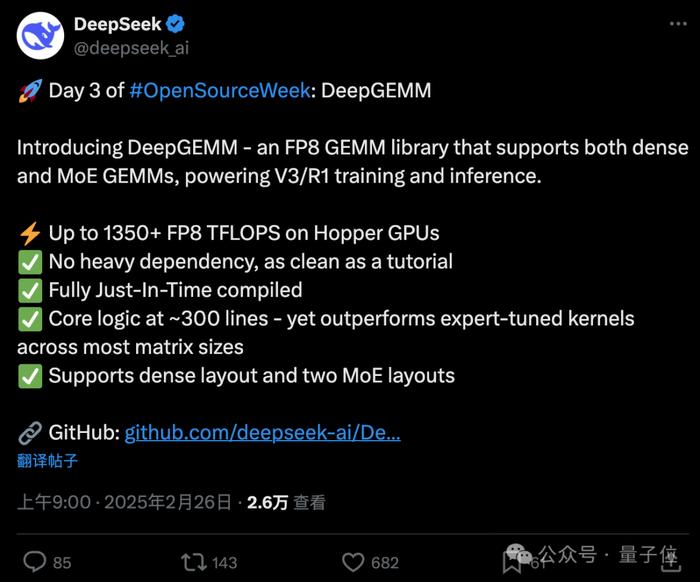

二、DeepSeek-R1的诞生背景与技术架构

DeepSeek-R1是基于深度学习技术开发的自然语言处理模型,它的核心是一个庞大的神经网络,通过训练海量数据来模拟人类的语言表达,技术再先进,也难免会出错。

三、训练数据的局限性:信息源头的“盲区”

DeepSeek-R1的“胡说八道”可能源于训练数据的局限性,尽管它学习了海量文本,但这些数据可能存在偏差或错误,某些领域的知识更新较快,而模型可能还停留在旧数据上。

四、模型算法的“黑箱”特性:难以预测的输出

深度学习模型被称为“黑箱”,因为其内部机制复杂,难以完全解释,DeepSeek-R1在生成文本时可能因为某些隐层的“误判”而输出错误信息,这是技术本身的一大挑战。

五、场景适配能力不足:脱离语境的“跑偏”

DeepSeek-R1在处理特定场景时,可能无法准确理解上下文,回答医疗问题时,它可能会给出不专业的建议,这种“跑偏”现象需要更多的场景化训练来改善。

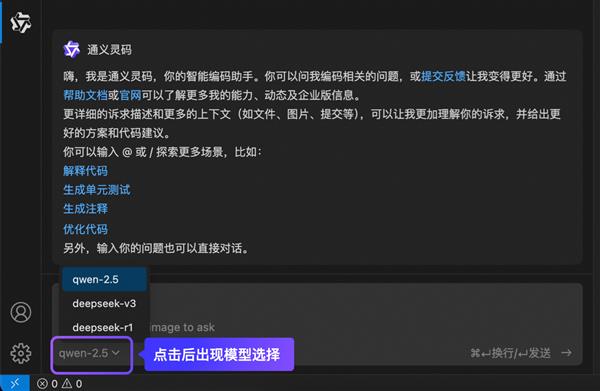

六、人为干预的缺失:如何规避错误输出?

目前,DeepSeek-R1的输出还未完全实现人为干预,虽然其设计者已经加入了一些过滤器,但仍无法完全避免错误信息的生成,更多的安全机制亟待开发。

七、用户期望与技术现实的差距

用户往往对人工智能抱有极高的期望,希望它能像人类一样“聪明”,DeepSeek-R1本质上仍是一台机器,其能力受限于技术和数据,这种差距可能导致用户对其“胡说八道”感到失望。

八、法规与伦理挑战:如何监管AI的“言论”?

随着人工智能的普及,如何监管其输出信息成为一个重要议题。《中华人民共和国人工智能伦理规范》明确规定,AI应避免传播错误信息,DeepSeek-R1的表现是否符合这些法规,值得探讨。

九、行业案例:其他AI模型的“翻车”经历

DeepSeek-R1并非孤例,此前,其他知名AI模型也曾因生成错误信息而引发争议,这些案例表明,人工智能的“胡说八道”现象是一个行业共性问题,需要更多努力来解决。

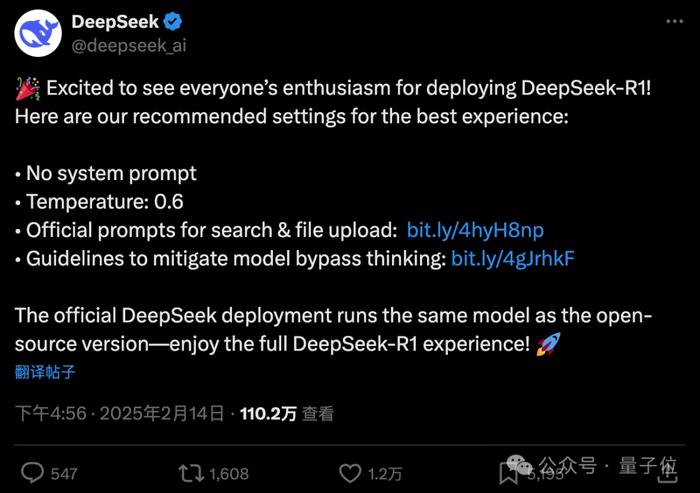

十、未来展望:如何让AI更“靠谱”?

要让DeepSeek-R1不再“胡说八道”,需要从多个方面入手:优化训练数据、提高场景适配能力、加强人为干预、完善法规监管等,只有多方协作,才能让人工智能真正为用户服务。

十一、理性看待AI的“不完美”

尽管DeepSeek-R1有时会“胡说八道”,但我们不能因此否定其价值,作为一项前沿技术,它仍在不断进化,我们需要以理性的态度看待它的“不完美”,并期待它在未来变得更加“靠谱”。

这篇文章结合了技术分析、行业案例和法规引用,旨在以轻松娱乐的方式为读者解读DeepSeek-R1的“胡说八道”现象,希望它能为您带来启发!

转载请注明来自索尔亿驰科技官网,本文标题:《惊!DeepSeek-R1为何频频‘胡说八道’?揭秘背后的惊人真相!》

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号